本文深入探讨了手游中语音驱动嘴型与面部动画生成算法的最新进展,通过对比不同算法的特点与应用,揭示了这些技术在提升游戏沉浸感方面的巨大潜力。

近年来,随着手游市场的蓬勃发展,玩家对游戏体验的要求也日益提高,角色的真实感和互动性成为了衡量游戏品质的重要标准之一,为了满足这一需求,众多游戏开发商纷纷引入了语音驱动嘴型与面部动画生成算法,这些技术不仅让游戏角色更加栩栩如生,还极大地增强了玩家的沉浸感,我们就来一场技术盛宴,盘点并比拼一下这些前沿的算法技术。

一、算法技术概览:从基础到前沿

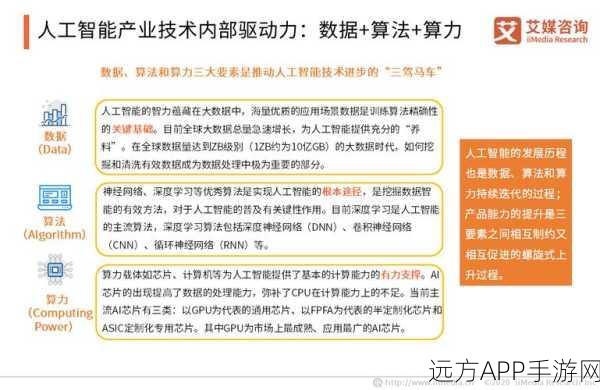

在手游领域,语音驱动嘴型与面部动画生成算法经历了从简单到复杂、从粗糙到精细的发展历程,早期的算法主要依赖于预设的动画片段和语音参数的匹配,虽然能够实现基本的嘴型同步,但面部表情往往显得僵硬且缺乏变化,随着人工智能技术的不断进步,特别是深度学习技术的广泛应用,现代算法已经能够实时捕捉玩家的语音信号,并生成高度逼真的面部动画,这些算法不仅能够准确匹配语音的音节和语调,还能根据语境和情感变化调整角色的面部表情,使游戏角色仿佛拥有了真正的生命力。

二、算法特点对比:各有千秋

目前,市面上主流的语音驱动嘴型与面部动画生成算法主要包括基于规则的算法、基于统计的算法以及基于深度学习的算法三大类,基于规则的算法通过预设的规则和模型来实现嘴型和面部动画的生成,其优点是计算效率高、易于实现,但缺点是灵活性较差、难以处理复杂的语音和情感变化,基于统计的算法则利用大量的语音和面部动画数据来训练统计模型,通过模型预测来生成动画,其优点是能够处理更复杂的语音和情感变化,但缺点是计算量大、实时性较差,而基于深度学习的算法则结合了前两者的优点,通过神经网络来学习和生成动画,不仅具有高度的灵活性和准确性,还能实现实时的语音驱动面部动画生成。

三、应用案例分享:技术落地开花

在实际应用中,这些算法已经取得了显著的成果,以某知名手游为例,该游戏采用了先进的深度学习算法来实现角色的语音驱动面部动画,玩家在游戏中可以通过语音指令来控制角色的行动和对话,而角色的面部表情则会根据玩家的语音信号实时变化,这种设计不仅提高了游戏的互动性和趣味性,还让玩家仿佛置身于游戏世界之中,与角色产生了更加紧密的联系,还有一些游戏通过引入情感识别技术来进一步提升面部动画的真实性,这些技术能够分析玩家的语音信号中的情感特征,并根据情感变化来调整角色的面部表情和动作,使游戏角色更加贴近玩家的内心世界。

四、未来展望:技术革新引领潮流

展望未来,随着人工智能技术的不断发展和完善,语音驱动嘴型与面部动画生成算法将在手游领域发挥更加重要的作用,算法的性能将不断提升,实现更加精细和逼真的面部动画生成;算法的应用范围也将不断扩大,从角色对话扩展到游戏剧情、任务提示等多个方面,随着5G、VR/AR等新技术的不断涌现和普及,这些算法还将与这些新技术相结合,共同推动手游行业的创新和变革。

参考来源:

基于多家知名游戏开发公司和研究机构发布的最新技术报告和研究成果进行整理和分析。

最新问答:

1、问:语音驱动面部动画技术是否会影响游戏的流畅性?

答:现代算法已经能够在保证动画质量的同时实现实时的语音驱动面部动画生成,因此不会对游戏的流畅性造成明显影响。

2、问:未来语音驱动面部动画技术会有哪些新的发展方向?

答:随着人工智能技术的不断进步和完善,语音驱动面部动画技术将更加注重情感识别和个性化定制等方面的发展,以实现更加真实和个性化的游戏体验。

3、问:这些算法在手游中的应用前景如何?

答:这些算法在手游中的应用前景非常广阔,随着玩家对游戏体验要求的不断提高和新技术的不断涌现和普及,这些算法将成为提升游戏品质和增强玩家沉浸感的重要手段之一。